개포동 골목을 걷는 기분으로, 이번 글에서는 MEMORY_MANAGEMENT의 핵심 개념을 쉽고 친근하게 풀어봅니다. 메모리 할당과 해제, 누수와 단편화(fragmentation) 같은 용어들이 낯설어도 걱정하지 마세요 — 차근차근 실무 관점에서 설명할게요. 실제 코드에서 흔히 마주치는 실수와 성능 문제를 사례 중심으로 짚어 드리고, 언제 어떤 기법을 써야 하는지도 알려드립니다.

개포동 아파트 관리에 비유하면 더 이해가 쉬워요: 자원을 효율적으로 배치하고, 불필요한 점검을 줄이는 방법까지 다룹니다. 정확하게 알아보도록 할게요.

메모리의 두 얼굴 — 스택과 힙 살짝 걸어보기

스택의 장점과 한계

스택은 함수 호출과 지역 변수의 고향이라 생각하면 편해요. 호출이 들어오면 프레임이 쌓이고, 반환되면 순서대로 정리되는 구조라서 할당/해제가 매우 빠르고 경량입니다. 그래서 단기간에 생겼다가 사라지는 값들, 예컨대 함수 내부에서만 쓰이는 임시 버퍼나 레지스터 캐시 역할을 하는 자료는 스택이 제격이죠.

하지만 크기가 정해져 있고(스택 크기 제한), 재귀 깊이나 큰 지역 배열 때문에 금방 포화될 수 있습니다. 또한 스택에 올릴 수 없는 동적 크기 객체나 수명이 호출 범위를 넘어서는 객체는 힙으로 가야 합니다. ([geeksforgeeks.org](https://www.geeksforgeeks.org/dsa/stack-vs-heap-memory-allocation/?utm_source=openai))

힙의 유연성 — 하지만 책임이 따른다

힙은 런타임에 크기를 정하는 객체들의 집합이며, 프로그래머(또는 가비지 콜렉터)가 명시적으로 해제해야 하거나 런타임이 자동으로 회수해줍니다. 힙의 장점은 수명이 자유롭고 큰 데이터 구조(예: 동적 배열, 연결 리스트, 그래프 노드)를 담기에 적합하다는 점입니다. 대신 할당/해제가 스택보다 느리고, 잘못 관리하면 메모리 누수(leak)나 댕글링 포인터(use-after-free), 단편화(fragmentation) 같은 문제가 생깁니다.

실무에서는 “짧게-빠르게-자동”은 스택, “길게-유연하게-책임”은 힙이라는 감각으로 구분하면 의사결정이 쉬워집니다. ([geeksforgeeks.org](https://www.geeksforgeeks.org/dsa/stack-vs-heap-memory-allocation/?utm_source=openai))

언제 스택, 언제 힙을 택할까

일반적인 규칙은 단순합니다: 객체의 수명과 크기를 기준으로 선택하세요. 수명과 범위가 함수 호출 안에 국한되면 스택을, 그렇지 않고 크기/수명/공유가 문제면 힙을 씁니다. 그런데 실무에서는 성능·캐시친화성·스레드 안전성 같은 비기능 요구가 결정을 바꿀 때가 많습니다.

예를 들어 짧은 반복 내에서 수많은 작은 객체를 힙에 자주 할당하면 오버헤드와 단편화가 쌓이므로 풀(pool)이나 arena 같은 전략을 고려해야 합니다. ([geeksforgeeks.org](https://www.geeksforgeeks.org/dsa/stack-vs-heap-memory-allocation/?utm_source=openai))

할당과 해제의 실제 — 누수가 생기는 지점들

일반적인 메모리 누수 패턴

누수는 할당한 메모리에 대한 마지막 참조를 잃어버릴 때 발생합니다. C/C++에서는 malloc/new 로 얻은 포인터를 적절히 free/delete 하지 않거나, 예외 경로에서 해제를 빼먹거나, 소유권이 명확하지 않은 API 설계 때문에 흔히 생깁니다. 또 콜백이나 전역 캐시, long-lived 컬렉션에 실수로 참조를 남겨두면 가비지 콜렉터가 있어도 객체가 회수되지 않는 경우도 있습니다.

실무에서 보이는 패턴을 빨리 알아채면 문제 해결 시간이 확 줄어듭니다. ([valgrind.org](https://valgrind.org/docs/manual/quick-start.html?utm_source=openai))

소유권 모델과 RAII의 힘

현대 C++ 실무에서는 소유권을 명확히 하고 RAII(Resource Acquisition Is Initialization) 패턴을 따르는 것이 표준입니다. unique_ptr 으로 단일 소유권을 표현하고, shared_ptr 은 공유 소유권이 필요할 때만 쓰는 등 규칙을 정하면 예외 경로나 분기에서 해제를 놓치는 일을 크게 줄일 수 있습니다.

언어가 제공하는 안전 장치를 적극 활용하는 것이 결국 디버깅 비용을 낮추는 지름길입니다. ([geeksforgeeks.org](https://www.geeksforgeeks.org/dsa/stack-vs-heap-memory-allocation/?utm_source=openai))

실전 팁: 책임 전파와 API 설계

API 설계 단계에서 ‘누가 free 할 것인가’를 명문화하세요. 반환되는 포인터의 소유권을 문서화하고, 예외 안전성을 확보하는 작은 래퍼를 만들어 사용하면 팀 합의 없이도 누수가 줄어듭니다. 또한 테스트에서 의도적으로 메모리 사용 패턴을 모방해 장기 실행 시나리오(메모리 사용량, RSS 변화)를 관찰하면 잠복한 누수를 조기에 발견할 수 있습니다.

([valgrind.org](https://valgrind.org/docs/manual/quick-start.html?utm_source=openai))

단편화(fragmentation)의 정체와 실무적 해법

내부 단편화와 외부 단편화, 그리고 왜 신경 써야 하는가

내부 단편화는 할당된 블록 내부에 남는 쓰이지 않는 공간, 외부 단편화는 자유 영역이 여러 조각으로 흩어져서 큰 연속 블록을 제공하지 못하는 상황을 말합니다. 짧게 말하면 내부 단편화는 ‘과도하게 큰 버킷에 작은 물건을 넣은 상태’, 외부 단편화는 ‘작은 빈틈들이 흩어져서 큰 물건을 못 넣는 상태’입니다.

운영체제 레벨뿐 아니라 애플리케이션 레벨 메모리 풀에서도 동일한 문제를 겪습니다. 단편화는 총 사용 가능한 메모리를 줄이고 캐시 친화성을 악화시키며, 결국 성능 저하나 OOM(Out Of Memory) 상황으로 이어질 수 있습니다. ([geeksforgeeks.org](https://www.geeksforgeeks.org/operating-systems/what-is-fragmentation-in-operating-system/?utm_source=openai))

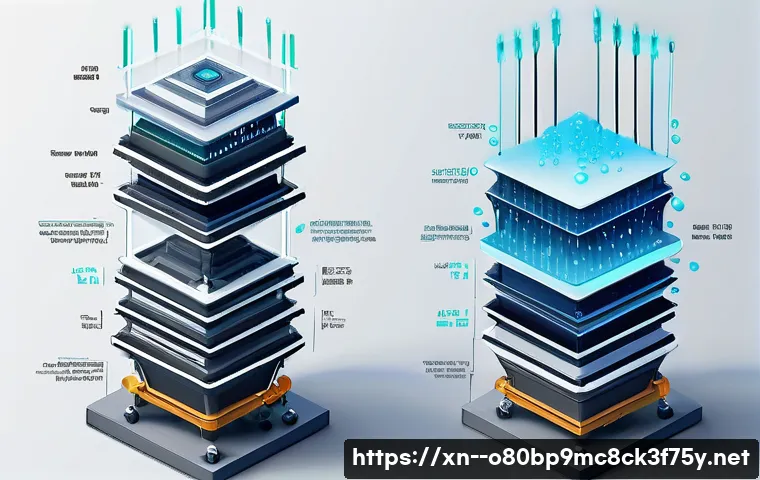

해결 전략: 페이징·컴팩션·풀·어레나

단편화 해소 기법은 여러 층에서 적용됩니다. OS/VM 레벨에서는 페이징이나 컴팩션으로 물리적/가상 주소 문제를 완화하고, 런타임/언어 레벨에서는 arena/region 기반 할당, object pool, slab allocator 같은 기법으로 내부 단편화를 줄입니다.

대량의 균일한 크기 오브젝트가 많다면 slab/slot 기반 풀을 쓰는 것이 메모리 사용 효율과 속도 모두에서 유리합니다. 또한 할당 전략을 바꾸는 것(예: 작은 객체는 per-thread cache 로 처리)만으로 단편화와 동시성 비용을 크게 낮출 수 있습니다. ([kahibaro.com](https://kahibaro.com/course/27-linux/1866-memory-management?utm_source=openai))

운영환경 현실: 언제 풀을 만들고 언제 일반 malloc 을 믿을까

풀을 도입하면 메모리 사용 패턴이 예측 가능한 워크로드에서 큰 이득을 봅니다. 반면 다양한 크기의 객체가 섞여 있고 사용 패턴이 불규칙하면 풀 관리 오버헤드가 더 커질 수 있습니다. 따라서 먼저 프로파일링으로 allocation size distribution 과 lifetime 을 파악한 뒤, hotspot(짧은 수명·잦은 할당/해제)이 확인되면 어레나나 풀을 적용하는 게 실전 원칙입니다.

또한 생산환경에서는 표준 malloc 대신 jemalloc, tcmalloc, mimalloc 같은 대체 allocator 를 시험해 보는 것도 효과적인 방법입니다. ([engineering.fb.com](https://engineering.fb.com/2011/01/03/core-infra/scalable-memory-allocation-using-jemalloc/?utm_source=openai))

실무에서 만나는 할당 전략과 인기 allocator 들

버디(buddy), 슬랩(slab), 그리고 arena 의 역할

운영체제와 런타임은 다양한 계층의 allocator 를 조합해서 씁니다. 버디는 페이지 단위로 큰 블록을 관리해 연속성 요구를 충족시키고, 슬랩 계열은 빈번히 생성/파괴되는 작은 객체를 위한 캐시를 제공합니다. 어플리케이션 레벨에서는 arena 나 pool 을 만들어 같은 성격의 객체를 묶어 할당/해제 오버헤드를 낮추는 방식이 자주 활용됩니다.

이런 계층적 설계는 동시성, 단편화, 캐시 활용 사이의 균형을 맞추는 데 유리합니다. ([kahibaro.com](https://kahibaro.com/course/27-linux/1866-memory-management?utm_source=openai))

jemalloc, tcmalloc, glibc malloc 비교와 선택 포인트

실무 사례를 보면 allocator 선택이 성능과 메모리 사용량에 큰 영향을 줍니다. jemalloc 은 다중 스레드 환경에서 경쟁을 줄이고 메모리 단편화를 잘 관리하는 편이라 서버 워크로드에서 인기 있고, tcmalloc 도 경쟁 감소와 스케일링에 강점이 있습니다. 반면 glibc 의 기본 allocator 는 단순한 워크로드에선 괜찮지만 고부하·높은 동시성 환경에서는 RSS가 커질 수 있습니다.

따라서 프로파일링을 통해 스레드 수, 할당 크기 분포, 메모리 RSS 변화를 기준으로 시험 교체를 해보는 것이 권장됩니다. ([engineering.fb.com](https://engineering.fb.com/2011/01/03/core-infra/scalable-memory-allocation-using-jemalloc/?utm_source=openai))

환경별 세팅 팁

컨테이너/VM 환경에서는 MALLOC_ARENA_MAX 같은 설정으로 arena 수를 조절하면 메모리 과다 사용을 억제할 수 있습니다. 또한 서버 애플리케이션은 프로덕션에서 대체 allocator 를 LD_PRELOAD로 간단히 시험해보고, 메모리·성능 벤치마크(throughput, latency, RSS)를 비교해 선택하세요.

작은 변화가 성능과 메모리 소비에 큰 영향을 주는 경우가 많으니 A/B 테스트를 통해 확증하는 습관이 중요합니다. ([lf-hyperledger.atlassian.net](https://lf-hyperledger.atlassian.net/wiki/spaces/BESU/pages/22156632/Reduce%2BMemory%2Busage%2Bby%2Bchoosing%2Ba%2Bdifferent%2Blow%2Blevel%2Ballocator?utm_source=openai))

중간 점검: 흔한 문제와 권장 대응 정리

| 문제 | 원인 | 증상 | 권장 대응 |

|---|---|---|---|

| 메모리 누수 | 해제 누락, 소유권 불명확 | 장기 실행 시 RSS 증가, swap 발생 | RAII/스마트포인터 적용, Valgrind/ASan 으로 추적 |

| 내부 단편화 | 고정 크 블록에 작은 오브젝트 배치 | 메모리 사용 효율 저하 | 슬랩/풀 사용, 오브젝트 크기 재평가 |

| 외부 단편화 | 랜덤한 크기·랜덤한 해제 | 큰 연속 블록 확보 실패 | 어레나/컴팩션/페이지 기반 전략 |

| 할당 경합 | multi-threaded 에서 중앙 allocator 병목 | 지연·스루풋 저하 | per-thread cache, jemalloc/tcmalloc 등 대체 allocator |

진단 도구와 실전 워크플로우

Valgrind, ASan 같은 도구 사용법 요점

메모리 문제를 잡을 때는 도구를 단계별로 조합하는 게 좋습니다. 먼저 AddressSanitizer(ASan)으로 use-after-free, 버퍼 오버런 같은 치명적 버그를 빠르게 잡고, Valgrind(Memcheck)로 누수와 할당 트레이스를 상세히 추적합니다. Valgrind 는 실제 할당 지점의 스택 트레이스를 보여주기 때문에 누수 근원을 찾는 데 유용하지만, 성능 오버헤드가 커서 전체 서비스에 적용하기보다는 테스트·디버그 환경에서 돌리는 게 일반적입니다.

([valgrind.org](https://valgrind.org/docs/manual/quick-start.html?utm_source=openai))

프로파일링과 실전 순서

워크플로우 예시는 이렇습니다: (1) 프로덕션에서 RSS·GC 로그·지연을 모니터링해 이상 징후 포착, (2) 로컬/스테이징에서 allocation-profile(샘플링 프로파일러)으로 핫스팟 추출, (3) ASan/Valgrind 로 버그 확인, (4) allocator 교체·메모리 풀 도입으로 개선, (5) 롤아웃 후 지표 비교.

한 단계씩 증거를 모으며 진행하면 롤백 비용을 줄일 수 있습니다. ([valgrind.org](https://valgrind.org/docs/manual/quick-start.html?utm_source=openai))

현장에서의 작은 습관들이 큰 차이를 만든다

작은 습관이 디버깅 시간을 좌우합니다. 예컨대 함수가 메모리를 반환할 때 항상 nullptr 로 초기화하는 관례, 스마트 포인터 규칙 문서화, 긴 수명의 글로벌 캐시에는 명확한 TTL이나 정리 로직을 두는 것 등이 누수와 단편화를 예방합니다. 또한 CI 단계에서 메모리 툴을 가볍게 돌려 주요 브랜치에 자동화해두면 회귀로 인한 메모리 문제를 초기에 잡을 수 있습니다.

([valgrind.org](https://valgrind.org/docs/manual/quick-start.html?utm_source=openai))

사례 중심: 실무에서 흔히 보는 실수와 해결법

반복 루프 안에서의 빈번한 할당

루프 내부에서 빈번히 malloc/free 또는 new/delete 를 반복하다 보면 할당 오버헤드와 단편화가 쌓입니다. 해결법은 객체 재사용, 고정 크기 버퍼 사용, 또는 per-thread arena 로 할당을 국한해 경쟁과 단편화를 줄이는 것입니다. 실제로 짧은 수명 객체의 경우는 풀을 만들어 recycle 하는 것이 성능과 메모리 안정성 모두에 유리합니다.

([kahibaro.com](https://kahibaro.com/course/27-linux/1866-memory-management?utm_source=openai))

글로벌 캐시와 의도치 않은 수명 연장

간단한 실수로 전역 캐시나 싱글턴에 참조를 남겨 객체가 회수되지 않는 경우가 많습니다. 해결은 캐시의 TTL을 두거나 약한 참조(weak reference)를 사용해 참조 그래프를 끊는 것입니다. 가비지 콜렉터가 있어도 참조가 존재하면 회수되지 않으니 ‘누가 마지막으로 참조를 버리는가’를 항상 체크하세요.

([valgrind.org](https://valgrind.org/docs/manual/quick-start.html?utm_source=openai))

성능과 메모리 트레이드오프 판단

메모리를 더 쓰면 CPU 경쟁을 줄여 지연이나 스루풋이 개선되는 케이스가 있고, 반대로 메모리 절약을 택하면 GC/스왑이 늘어 성능이 악화될 수 있습니다. 따라서 단순히 메모리 사용량만 보고 최적화하지 말고, 지표(지연, 스루풋, RSS, GC pause)를 함께 보고 의사결정하세요.

A/B 테스트를 통해 트레이드오프를 계량화하는 습관이 중요합니다. ([engineering.fb.com](https://engineering.fb.com/2011/01/03/core-infra/scalable-memory-allocation-using-jemalloc/?utm_source=openai))

글을마치며

스택과 힙의 차이, 그리고 단편화·누수 같은 문제들은 이론만큼이나 실전에서의 관찰과 습관이 중요합니다. 작은 규칙 하나(명확한 소유권, RAII, 스마트 포인터)와 도구 한 가지(ASan/Valgrind)를 꾸준히 적용하면 버그를 조기에 잡고 디버깅 비용을 크게 줄일 수 있습니다. 프로파일링으로 할당 패턴을 파악한 뒤 적절한 allocator 나 풀 전략을 도입하면 성능과 메모리 안정성 사이의 균형을 맞출 수 있습니다. 실무에서는 ‘먼저 측정하고, 그다음 최적화하라’는 원칙을 잊지 마세요.

([clang.llvm.org](https://clang.llvm.org/docs/AddressSanitizer.html?utm_source=openai))

알아두면 쓸모 있는 정보

1. RAII와 스마트 포인터로 소유권을 명확히 하세요 — 예외 경로나 분기에서 해제 누락을 크게 줄여줍니다.

2. 개발·CI 단계에서 AddressSanitizer 를 돌려서 use-after-free 나 버퍼 오버런을 빠르게 잡으세요.

(가볍고 빠른 검사로 반복적인 회귀를 예방합니다).

([clang.llvm.org](https://clang.llvm.org/docs/AddressSanitizer.html?utm_source=openai))

3. 메모리 누수 추적은 Valgrind(Memcheck)를 스테이징에서 활용해 할당 트레이스를 확인하세요.

(성능 오버헤드가 크므로 프로덕션이 아닌 테스트 환경에서 사용합니다).

([valgrind.org](https://valgrind.org/docs/manual/quick-start.html?utm_source=openai))

4. 프로파일링으로 allocation size·lifetime 분포를 본 뒤 jemalloc/tcmalloc 같은 대체 allocator 또는 arena/pool 전략을 시험하세요.

(대체 allocator 는 다중 스레드·단편화 문제를 개선할 수 있습니다).

([engineering.fb.com](https://engineering.fb.com/2011/01/03/core-infra/scalable-memory-allocation-using-jemalloc/?utm_source=openai))

5. 롤아웃 전 A/B 테스트로 RSS·지연·스루풋을 계량화하고, 모니터링 지표(메모리 사용량, GC 로그, latency)를 기준으로 채택 여부를 결정하세요.

중요 사항 정리

객체의 수명과 크기를 기준으로 스택/힙을 선택하고, 변경 전에는 반드시 프로파일링으로 증거를 수집하세요. 자동 소유권(예: RAII)과 정적 검사·동적 검사를 병행하면 치명적 메모리 버그를 줄일 수 있습니다. 단편화·경합 문제는 적절한 allocator 설정이나 풀·arena 도입으로 완화하고, 변경 후에는 지표 기반으로 검증·모니터링을 지속하세요.

([engineering.fb.com](https://engineering.fb.com/2011/01/03/core-infra/scalable-memory-allocation-using-jemalloc/?utm_source=openai))

자주 묻는 질문 (FAQ) 📖

질문: 메모리 누수(memory leak)란 무엇이고 실무에서 어떻게 찾고 고치나요?

답변: 메모리 누수는 더 이상 쓰지 않는 힙(동적) 메모리를 해제하지 않아 프로그램 전체 메모리 사용이 점점 커지는 현상입니다. 실무적 대응은 (1) 소유권 명시: raw pointer 대신 std::uniqueptr/std::sharedptr 같은 스마트 포인터 혹은 컨테이너(std::vector, std::string)를 쓰고 RAII 패턴으로 자원 해제를 맡기는 것, (2) 도구로 탐지: AddressSanitizer(LeakSanitizer)나 Valgrind 같은 런타임 검사기로 누수 위치와 스택트레이스를 확인하는 것, (3) 코드 습관: 예외 경로·초기화 실패 경로에서도 자원 해제가 보장되는지 점검하고, 전역 캐시나 싱글턴에 쌓이는 참조를 주기적으로 검토·정리하는 것입니다.

일반적인 실수로는 컨테이너에 남긴 객체, 콜백/리스너가 해제되지 않은 경우, 순환 참조(sharedptr ↔ sharedptr) 등이 있으니 weakptr 사용이나 명시적 해제(또는 소유권 재설계)로 해결하세요. ([palospublishing.com](https://palospublishing.com/understanding-c-memory-leaks-and-how-to-avoid-them/?utmsource=openai))

질문: 단편화(fragmentation)는 왜 생기고 어떻게 완화하나요?

답변: 단편화는 크게 내부(internal)와 외부(external) 단편화로 나뉩니다. 내부 단편화는 할당 단위가 요청보다 커서 남는 공간이 낭비되는 경우, 외부 단편화는 여러 할당/해제가 반복되며 자유 공간이 작은 조각으로 흩어져 큰 블록을 만들지 못하는 경우입니다. 실무 해법은 객체 수명과 사용 패턴에 맞춘 전략을 쓰는 것: 고정크기 오브젝트엔 slab/pool allocator 나 slab 캐시를 쓰고(재사용으로 fragmentation 감소), 동적 객체는 arena/bump allocator 로 묶어 한 번에 해제하거나 미리 reserve 해서 재할당 빈도를 줄이며, 필요하면 jemalloc/tcmalloc 같은 현대적 allocator 를 도입해 내부 분할·병합 전략을 활용합니다.

C/C++처럼 런타임에서 강제 컴팩션이 어려운 경우에는 애플리케이션 수준에서 메모리 풀·객체 그룹화로 단편화를 예방하는 것이 현실적입니다(최근 연구·대안으로 malloc 대체기법이나 compaction 시도 사례도 있습니다). ([geeksforgeeks.org](https://www.geeksforgeeks.org/difference-between-internal-and-external-fragmentation/?utmsource=openai))

질문: 가비지 컬렉션(GC)과 수동 메모리 관리 중 언제 어떤 걸 선택해야 하나요?

답변: 정답은 요구사항에 따라 달라집니다. GC는 짧은 수명 객체가 많고 할당/해제가 빈번한 서버·비즈니스 로직에서 개발 편의성과 안전성(누수·use-after-free 감소)을 크게 향상시키며, 현대 GC는 세대별·병행 수집으로 성능 페널티를 줄여 실무에서 유리한 경우가 많습니다.

반면 실시간성(게임 엔진, 임베디드, 저지연 금융 시스템)이나 메모리 제약이 극심한 환경에서는 GC가 일으키는 불확실한 멈춤·오버헤드 때문에 수동 관리나 커스텀 메모리 풀이 더 적합합니다. 현실적 타협으로는 중요한 경로는 수동 관리(혹은 풀)로 처리하고 나머지는 GC/고수준 런타임에 맡기는 하이브리드 설계, 또는 jemalloc 같은 고성능 allocator 로 파편화·할당 비용을 줄이는 방식이 자주 쓰입니다.

선택 시에는 할당 패턴(짧은 생명 vs 장기), 레이턴시 요구, 디버깅·운영 비용을 종합하여 판단하세요. ([gist.github.com](https://gist.github.com/tivrfoa/e1255e26762a67cf867119a1f372760f?utmsource=openai))